| KAIST开发出防止深度学习被攻击的对抗性算法 | ||

|

||

< 图片来源:电子新闻 >

11月15日,韩国科学技术院(KAIST)表示,电气与电子工程学院卢容万(音)教授研究组开发出了防御对检测物体的深度学习神经网络的对抗性攻击的算法。该研究成果于本月1日刊登在影像处理领域国际著名期刊《IEEE Transactions on Image Processing》上。

深度学习神经网络技术在无人驾驶和物体检测等多个领域作为核心技术备受关注,目前基于深度学习的检测网络可以在输入图像中注入对抗性模式,从而导致错误的预测结果。可以进行对抗性模式攻击,使包含人为模式的物体无法检测到。

当基于深度学习的模型应用于国防、医疗和自动驾驶时,就会成为问题。在国防监视侦察领域,如果对手伪装、侵入对抗性模式,可能会发生无法检测的情况。

现有的研究需要追加复杂的模块或重新学习,因此很难用于实时操作的算法。

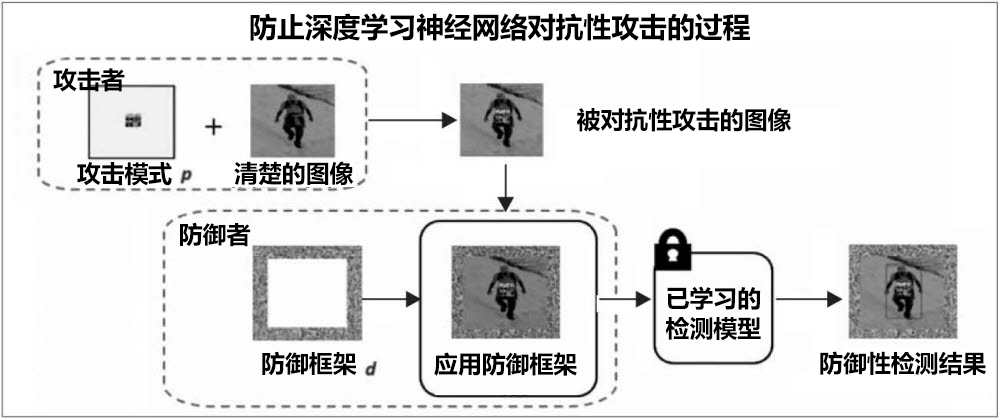

研究组反过来利用对抗性模式攻击原理,找到了在不接近学习网络的情况下,在输入端进行防御的防御框架技术。

与对抗性攻击相反,在检测物体时,深度学习模型会得出正确的预测结果。像矛和盾的斗争一样,与对抗性模式一起竞争性地学习,反复这一过程,为了在所有对抗性模式攻击具有高防御性能,进行了优化。

研究组确认,通过改变附加在输入图像外部的防御框架,可以轻松调节防御性能。开发防御框架在INRIA检测基准数据组中,与现有的防御算法相比,平均准确度提高了31.6%。

开发防御框架在实时探测物体时,无需重新学习模型,就可以防御对抗性模式攻击,因此有望大幅节省预测时间和费用。

卢勇万(音)教授表示:"此次开发的防御技术在应用人工智能(AI)模型时提出了实用的对抗性防御。可以适用于国防监视侦察、安全、无人驾驶领域"。

信息来源:

发布机构: 韩国网络媒体->电子新闻

发布时间:2022.11.15

|

科研动态

韩中科学技术合作信息及交流平台的先锋!